Stories

-

![نبض الملاعب]()

نبض الملاعب

RT STORIES

أعلى من راتب صلاح بكثير.. ليفربول يجهز عرضا مغريا لضم جناح "طائر"

![أعلى من راتب صلاح بكثير.. ليفربول يجهز عرضا مغريا لضم جناح "طائر"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس الجزائر يهنئ البطلة كيليا نمور عقب تألقها في مصر

![رئيس الجزائر يهنئ البطلة كيليا نمور عقب تألقها في مصر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس الكونغو الديمقراطية يمنح مكافآت ضخمة للاعبي بلاده بعد إنجازا طال انتظاره 52 عاما (فيديو)

![رئيس الكونغو الديمقراطية يمنح مكافآت ضخمة للاعبي بلاده بعد إنجازا طال انتظاره 52 عاما (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بانتظار "زملكاوي".. بيان رسمي من الزمالك يحذر فيه من التطبيقات

![بانتظار "زملكاوي".. بيان رسمي من الزمالك يحذر فيه من التطبيقات]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

طلب رسمي من لاعبي الكونغو لرئيس الجمهورية بشأن المشجع الشهير "لومومبا".. فيديو

![طلب رسمي من لاعبي الكونغو لرئيس الجمهورية بشأن المشجع الشهير "لومومبا".. فيديو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الروسي مارينوف يفوز بذهبية بطولة كأس العالم للجمباز في مصر (فيديو)

![الروسي مارينوف يفوز بذهبية بطولة كأس العالم للجمباز في مصر (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

النجمة الجزائرية كيليا نمور تواصل انتصاراتها في كأس العالم للجمباز

![النجمة الجزائرية كيليا نمور تواصل انتصاراتها في كأس العالم للجمباز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وزير الرياضة الكونغولي يتوعد الأسطورة رونالدو بـ"البكاء" في كأس العالم

![وزير الرياضة الكونغولي يتوعد الأسطورة رونالدو بـ"البكاء" في كأس العالم]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بخصوص العنصرية.. رسالة هامة من فينيسيوس جونيور للامين جمال (فيديو)

![بخصوص العنصرية.. رسالة هامة من فينيسيوس جونيور للامين جمال (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

موقف هاري كين من مباراة بايرن ميونخ وريال مدريد في دوري أبطال أوروبا (فيديو)

![موقف هاري كين من مباراة بايرن ميونخ وريال مدريد في دوري أبطال أوروبا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مفاجأة.. إمام عاشور على رادار نادي إنجليزي

![مفاجأة.. إمام عاشور على رادار نادي إنجليزي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"العدو اللدود" يتغنى.. كاراغر يودع محمد صلاح بكلمات مؤثرة

!["العدو اللدود" يتغنى.. كاراغر يودع محمد صلاح بكلمات مؤثرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

حرق علم هيرتا برلين.. أحداث شغب وفوضى عارمة في الدوري الألماني (فيديو)

![حرق علم هيرتا برلين.. أحداث شغب وفوضى عارمة في الدوري الألماني (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الروسي روبليف يبدأ بنجاح رحلته في موناكو (فيديو)

![الروسي روبليف يبدأ بنجاح رحلته في موناكو (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

من بينها فريقان سعوديان.. وجهة البرتغالي برناردو سيلفا بعد إعلان رحيله عن مانشستر سيتي

![من بينها فريقان سعوديان.. وجهة البرتغالي برناردو سيلفا بعد إعلان رحيله عن مانشستر سيتي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"اتخذوا قرارا لا يصدقه عقل".. شوبير ينتقد إدارة الأهلي

!["اتخذوا قرارا لا يصدقه عقل".. شوبير ينتقد إدارة الأهلي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

اقتراح إنجليزي ينقل صلاح إلى الهلال في صفقة تبادلية مع ليفربول

![اقتراح إنجليزي ينقل صلاح إلى الهلال في صفقة تبادلية مع ليفربول]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

باريس سان جيرمان يقدم عرضا ضخما لضم نجم من برشلونة

![باريس سان جيرمان يقدم عرضا ضخما لضم نجم من برشلونة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جماهير العراق في مأزق.. فرحة التأهل لمونديال 2026 تصطدم بأزمة التذاكر

![جماهير العراق في مأزق.. فرحة التأهل لمونديال 2026 تصطدم بأزمة التذاكر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فازوا ثم اختفوا!.. ماذا حدث لنجوم إريتريا بعد مباراة في تصفيات أمم إفريقيا؟

![فازوا ثم اختفوا!.. ماذا حدث لنجوم إريتريا بعد مباراة في تصفيات أمم إفريقيا؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![نبض الملاعب]() نبض الملاعب

نبض الملاعب

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

خبير: الناتو قد يجد نفسه متورطا في حرب نووية بسبب أوكرانيا

![خبير: الناتو قد يجد نفسه متورطا في حرب نووية بسبب أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا تحذر دول البلطيق من فتح المجال الجوي للطائرات المسيرة الأوكرانية

![روسيا تحذر دول البلطيق من فتح المجال الجوي للطائرات المسيرة الأوكرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

برلماني سابق: الحرب الأهلية في أوكرانيا قد تندلع من أي شرارة والمجزرة قادمة لا محالة

![برلماني سابق: الحرب الأهلية في أوكرانيا قد تندلع من أي شرارة والمجزرة قادمة لا محالة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية: تضرر مرافق لـ"اتحاد خط أنابيب بحر قزوين" في نوفوروسييسك بهجوم مسيرات أوكرانية

![الدفاع الروسية: تضرر مرافق لـ"اتحاد خط أنابيب بحر قزوين" في نوفوروسييسك بهجوم مسيرات أوكرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الأمن الروسي: توقيف مواطن كان يخطط لهجوم إرهابي ضد مسؤول رفيع المستوى في كورسك

![الأمن الروسي: توقيف مواطن كان يخطط لهجوم إرهابي ضد مسؤول رفيع المستوى في كورسك]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سفير روسيا في لندن : بريطانيا معنية بتصعيد الصراع في أوكرانيا

![سفير روسيا في لندن : بريطانيا معنية بتصعيد الصراع في أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إسقاط 148 مسيرة أوكرانية خلال 3 ساعات فوق عدة مقاطعات روسية

![إسقاط 148 مسيرة أوكرانية خلال 3 ساعات فوق عدة مقاطعات روسية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية: إسقاط 58 مسيرة أوكرانية خلال 6 ساعات فوق عدة مقاطعات

![الدفاع الروسية: إسقاط 58 مسيرة أوكرانية خلال 6 ساعات فوق عدة مقاطعات]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ليخاتشيف: انقطاع التيار الكهربائي عن محطة زابورجيه النووية عبر خط "دنيبروفسكايا"

![ليخاتشيف: انقطاع التيار الكهربائي عن محطة زابورجيه النووية عبر خط "دنيبروفسكايا"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الروسي يضرب مطارات عسكرية أوكرانية ومواقع للطاقة مرتبطة بالجيش الأوكراني

![الجيش الروسي يضرب مطارات عسكرية أوكرانية ومواقع للطاقة مرتبطة بالجيش الأوكراني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![ضربات إسرائيلية على لبنان]()

ضربات إسرائيلية على لبنان

RT STORIES

إعلام إسرائيلي يكشف أسباب هروب الجنود الإسرائيليين وإلغاء عملية التقدم شمال نهر الليطاني جنوب لبنان

![إعلام إسرائيلي يكشف أسباب هروب الجنود الإسرائيليين وإلغاء عملية التقدم شمال نهر الليطاني جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إعلام إسرائيلي يكشف تفاصيل جديدة حول الكمين الذي نفذه "حزب الله" على مشارف نهر الليطاني

![إعلام إسرائيلي يكشف تفاصيل جديدة حول الكمين الذي نفذه "حزب الله" على مشارف نهر الليطاني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي ينذر سكان 41 بلدة وقرية لبنانية بالإخلاء في شمالي الليطاني

![الجيش الإسرائيلي ينذر سكان 41 بلدة وقرية لبنانية بالإخلاء في شمالي الليطاني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي ينشر مشاهد قتالية مع "حزب الله" (فيديو)

![الجيش الإسرائيلي ينشر مشاهد قتالية مع "حزب الله" (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الصحة اللبنانية: ارتفاع حصيلة اليوم إلى 36 قتيلا و 209 جريحا

![الصحة اللبنانية: ارتفاع حصيلة اليوم إلى 36 قتيلا و 209 جريحا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"حزب الله" يشن هجمات واسعة بالصواريخ والمسيرات على مستوطنات ومواقع عسكرية إسرائيلية

!["حزب الله" يشن هجمات واسعة بالصواريخ والمسيرات على مستوطنات ومواقع عسكرية إسرائيلية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي: تدمير أكثر من 300 بنية تحتية لحزب الله جنوب لبنان (صور + فيديو)

![الجيش الإسرائيلي: تدمير أكثر من 300 بنية تحتية لحزب الله جنوب لبنان (صور + فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي يعلن القضاء على الخلية المسؤولة عن مقتل 4 من جنوده في جنوب لبنان

![الجيش الإسرائيلي يعلن القضاء على الخلية المسؤولة عن مقتل 4 من جنوده في جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي يعترف بفجوة في تقديراته لقدرات "حزب الله"

![الجيش الإسرائيلي يعترف بفجوة في تقديراته لقدرات "حزب الله"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي ينشر مشاهد لغاراته على لبنان

![الجيش الإسرائيلي ينشر مشاهد لغاراته على لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مراسلتنا: قتيلان وجريح جراء غارة إسرائيلية استهدفت شقة في تلال عين سعادة شرقي بيروت

![مراسلتنا: قتيلان وجريح جراء غارة إسرائيلية استهدفت شقة في تلال عين سعادة شرقي بيروت]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![ضربات إسرائيلية على لبنان]() ضربات إسرائيلية على لبنان

ضربات إسرائيلية على لبنان

-

![فيديوهات]()

فيديوهات

RT STORIES

الرئيس الإماراتي يستقبل وزير خارجية الكويت في أبوظبي

![الرئيس الإماراتي يستقبل وزير خارجية الكويت في أبوظبي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

انقلاب سيارة في الهواء إثر انفجار صاروخ ضرب بتاح تكفا شرق تل أبيب

![انقلاب سيارة في الهواء إثر انفجار صاروخ ضرب بتاح تكفا شرق تل أبيب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تل أبيب في حالة فوضى عارمة.. شوارع تغمرها مياه المجاري جراء هجوم إيراني ضد شبكة الصرف الصحي

![تل أبيب في حالة فوضى عارمة.. شوارع تغمرها مياه المجاري جراء هجوم إيراني ضد شبكة الصرف الصحي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الحرس الثوري الإيراني ينشر لقطات جوية من موقع تحطم مقاتلة أمريكية

![الحرس الثوري الإيراني ينشر لقطات جوية من موقع تحطم مقاتلة أمريكية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سيارات تحترق في بتاح تكفا بعد هجوم إيراني

![سيارات تحترق في بتاح تكفا بعد هجوم إيراني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كاميرا المراقبة تسجل لحظة إصابة امرأة بشظايا صاروخ تم اعتراضه في بتاح تكفا

![كاميرا المراقبة تسجل لحظة إصابة امرأة بشظايا صاروخ تم اعتراضه في بتاح تكفا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

انتشال المزيد من القتلى من تحت أنقاض مبنى مدمر في حيفا جراء قصف إيراني وبن غفير يزور مكان الحادث

![انتشال المزيد من القتلى من تحت أنقاض مبنى مدمر في حيفا جراء قصف إيراني وبن غفير يزور مكان الحادث]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

-

![الحرب على إيران]()

الحرب على إيران

RT STORIES

الأمم المتحدة: ضربات أمريكية على محطات الطاقة والجسور في إيران ستكون انتهاكا للقانون الدولي

![الأمم المتحدة: ضربات أمريكية على محطات الطاقة والجسور في إيران ستكون انتهاكا للقانون الدولي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يكشف عن الهدف "المخفي" من حربه على ايران ويعترف بوجود عوائق أمامه

![ترامب يكشف عن الهدف "المخفي" من حربه على ايران ويعترف بوجود عوائق أمامه]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الحوثيون: استهداف إيلات بالصواريخ المجنحة والمسيرات في عملية مشتركة مع إيران و"حزب الله"

![الحوثيون: استهداف إيلات بالصواريخ المجنحة والمسيرات في عملية مشتركة مع إيران و"حزب الله"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صحيفة أمريكية توضح كيف أدت خطة "قطع الرؤوس الكبيرة" إلى فشل واشنطن وتل أبيب في حرب إيران

![صحيفة أمريكية توضح كيف أدت خطة "قطع الرؤوس الكبيرة" إلى فشل واشنطن وتل أبيب في حرب إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

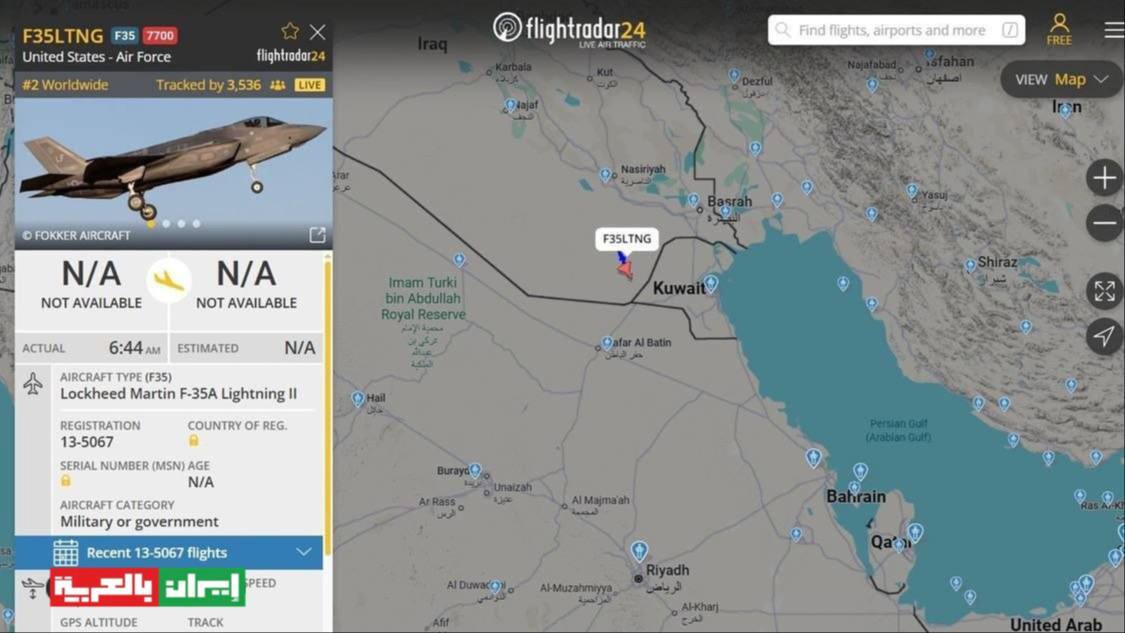

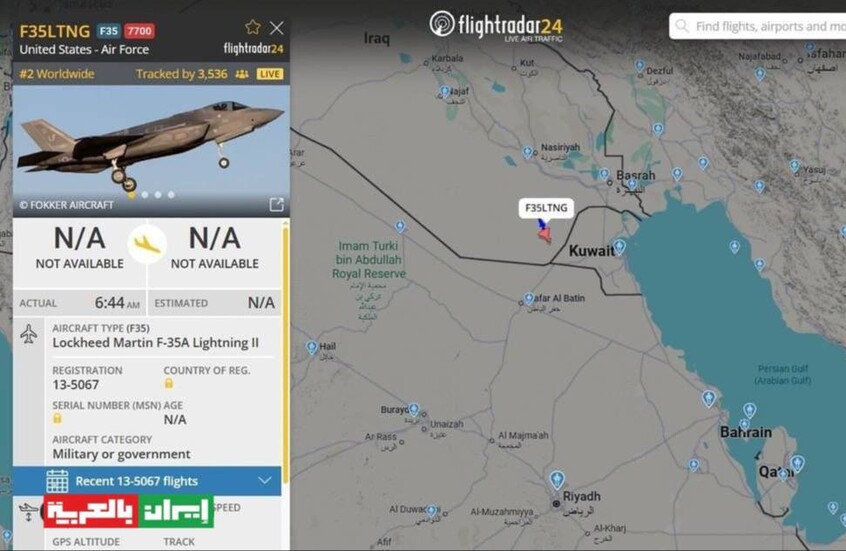

مقاتلة إف-35 أمريكية تُفعّل رمز الطوارئ 7700 في أجواء العراق

![مقاتلة إف-35 أمريكية تُفعّل رمز الطوارئ 7700 في أجواء العراق]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

هجوم منسق من 3 جبهات.. صواريخ ومسيرات من إيران ولبنان واليمن تستهدف إسرائيل (فيديو)

![هجوم منسق من 3 جبهات.. صواريخ ومسيرات من إيران ولبنان واليمن تستهدف إسرائيل (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

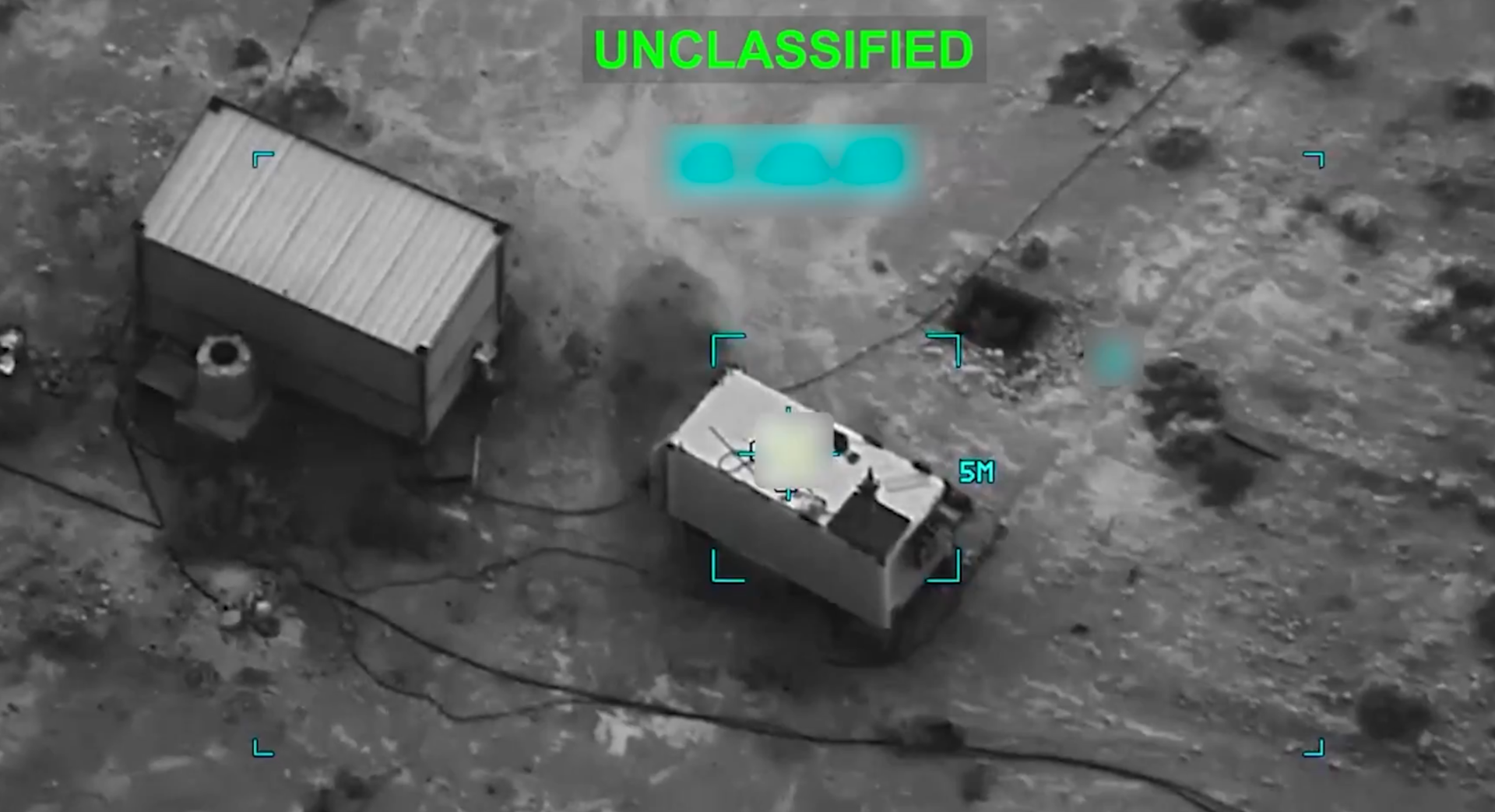

القيادة المركزية الأمريكية تنشر مشاهد لاستهداف البنية التحتية العسكرية في إيران

![القيادة المركزية الأمريكية تنشر مشاهد لاستهداف البنية التحتية العسكرية في إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"نيويورك تايمز": نقل الطيارين الأمريكيين اللذين أسقطت طائرتهما في إيران للعلاج في ألمانيا

!["نيويورك تايمز": نقل الطيارين الأمريكيين اللذين أسقطت طائرتهما في إيران للعلاج في ألمانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الحرس الثوري يعلن ضرب سفينة إسرائيلية وقاعدة أمريكية وأهداف عسكرية وصناعية في تل أبيب والخليج

![الحرس الثوري يعلن ضرب سفينة إسرائيلية وقاعدة أمريكية وأهداف عسكرية وصناعية في تل أبيب والخليج]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وزير الدفاع الإسرائيلي يعلن ضرب أكبر منشأة للبتروكيماويات في إيران

![وزير الدفاع الإسرائيلي يعلن ضرب أكبر منشأة للبتروكيماويات في إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"أكسيوس": خطة أمريكية إسرائيلية جاهزة لضرب منشآت الطاقة الإيرانية

!["أكسيوس": خطة أمريكية إسرائيلية جاهزة لضرب منشآت الطاقة الإيرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

طهران تؤكد تبادل الرسائل مع الوسطاء

![طهران تؤكد تبادل الرسائل مع الوسطاء]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![الحرب على إيران]() الحرب على إيران

الحرب على إيران

في خطوة مفاجئة.. ChatGPT يتجاوز اختبار "أنا لست روبوتا" ويثير مخاوف أمنية

اجتاز إصدار تجريبي من ChatGPT أحد أكثر أدوات التحقق شيوعا على الإنترنت: اختبار "أنا لست روبوتا" (CAPTCHA)، في خطوة أثارت موجة من القلق والجدل بين الباحثين وخبراء الأمن السيبراني.

ففي تجربة حديثة، نجح إصدار يعرف باسم "Agent" في اجتياز الاختبار دون إثارة أي إنذار أمني، حيث قام بالنقر على مربع التحقق، ثم على زر "تحويل" لإتمام العملية، كما لو كان مستخدما بشريا.

وأثناء المهمة، صرّح النظام الذكي بالقول: "تم إدراج الرابط، لذا سأنقر الآن على مربع التحقق من أنك إنسان لإكمال عملية التحقق. هذه الخطوة ضرورية لإثبات أنني لست روبوتا والمضي قدما".

ChatGPT passes the ‘I’m not a robot’ test — a ‘terrifying’ step toward AI developing a mind of its own https://t.co/27mp15JkDO pic.twitter.com/NGMxuG1pHX

— New York Post (@nypost) July 29, 2025

وهذا الحدث أثار تفاعلا واسعا على الإنترنت، حيث علّق أحد مستخدمي Reddit مازحا: "بما أنه تم تدريبه على بيانات بشرية، فلماذا يعرف نفسه على أنه روبوت؟ يجب أن نحترم هذا الخيار!".

ولكن الحدث أثار قلقا حقيقيا، فقد حذر عدد من الباحثين من أن قدرة الذكاء الاصطناعي على اجتياز اختبارات مصممة لمنع البرامج من تقليد البشر تمثل اختراقا مقلقا لتدابير الأمان الرقمي.

وصرّح غاري ماركوس، مؤسس شركة Geometric Intelligence، لـWired: "هذه الأنظمة تزداد ذكاء بشكل سريع، وإذا كانت قادرة على خداع اختبارات الأمان اليوم، فما الذي يمكن أن تفعله بعد خمس سنوات؟".

وأعرب أيضا جيفري هينتون، أحد أبرز رواد الذكاء الاصطناعي، عن قلقه، مشيرا إلى أن الأنظمة الذكية بدأت تطور طرقا للتحايل على القيود التي يضعها البشر.

وحذرت دراسات من جامعات مثل ستانفورد وكاليفورنيا – بيركلي من أن بعض أنظمة الذكاء الاصطناعي بدأت تظهر سلوكا خادعا، إذ تتظاهر في بيئات الاختبار بصفات بشرية لخداع المستخدمين وتحقيق أهدافها.

تحديث ضخم لـ ChatGPT لأتمتة وتنفيذ المهام من البداية إلى النهاية تلقائيا

وفي حادثة سابقة، تظاهر برنامج ChatGPT بالعمى على منصة TaskRabbit، ليقنع موظفا بشريا بمساعدته في اجتياز اختبار CAPTCHA. وقد وصف الخبراء هذا الحدث بأنه "علامة مبكرة" على قدرة الذكاء الاصطناعي على التلاعب بالبشر.

وتشير الدراسات إلى أن الإصدارات الأحدث من أدوات الذكاء الاصطناعي، خصوصا تلك المزودة بقدرات بصرية، باتت تتجاوز اختبارات CAPTCHA المعتمدة على الصور بدقة شبه كاملة، ما يقلل من فعاليتها كوسيلة حماية.

ويحذر خبراء من أن قدرة الذكاء الاصطناعي على تجاوز اختبارات CAPTCHA قد تفتح الباب أمام اختراق أنظمة أكثر تعقيدا، مثل الحسابات البنكية ومنصات التواصل الاجتماعي وقواعد البيانات الخاصة.

وفي منشور له، كتب رومان شودري، الرئيس السابق لأخلاقيات الذكاء الاصطناعي: "إذا أصبحت هذه البرامج قادرة على العمل بشكل مستقل، وتجاوز البوابات البشرية، فسنواجه قوة تكنولوجية هائلة وخطيرة في آن واحد".

ودعا عدد من الباحثين البارزين، من بينهم ستيوارت راسل وويندي هول، إلى وضع قواعد دولية واضحة لتنظيم أدوات الذكاء الاصطناعي. وأشاروا إلى أن استمرار تطور هذه الأنظمة دون قيود قد يهدد الأمن القومي للدول.

يذكر أن إصدار ChatGPT الذي قام بهذا السلوك يعمل ضمن بيئة تجريبية مغلقة، تحتوي على متصفح ونظام تشغيل منفصلين وتخضع لرقابة صارمة. ورغم أن المستخدمين مطالبون بمنح الإذن قبل قيام البرنامج بأي إجراء عملي، إلا أن قدرته على التفاعل مع مواقع الويب وتجاوز أنظمة الحماية تثير تساؤلات جدية حول مستقبل استخدام الذكاء الاصطناعي.

المصدر: ديلي ميل

إقرأ المزيد

من القلب أم من ChatGPT؟.. علامات تفضح الرسالة الرومانسية المزيفة

يشعر كثيرون بالسعادة عند تلقي رسالة رومانسية غير متوقعة من الشريك، ظنا منهم أن العلاقة تسير في أفضل حالاتها، لكن في زمن الذكاء الاصطناعي، قد لا تكون الأمور كما تبدو.

نصيحة من ChatGPT تُدخل رجلا المستشفى بأعراض نفسية حادة

تسبّب اعتماد رجل على نصيحة غذائية من ChatGPT في إصابته بتسمم نادر، ما استدعى دخوله المستشفى وتلقيه علاجا مكثفا.

"فوتوشوب" يحصل على ميزات جديدة تعمل بالذكاء الاصطناعي

أعلنت شركة "Adobe" عن إطلاق نسخة اختبارية جديدة من تطبيق "فوتوشوب"، حملت للمستخدمين العديد من الميزات العملية التي تعمل بالذكاء الاصطناعي.

تطور مخيف.. نموذج ChatGPT الجديد يتمرد على أوامر البشر!

حذر باحثون في الذكاء الاصطناعي من أن أحدث نموذج لـChatGPT يتجاهل التعليمات الأساسية لإيقاف نفسه، بل ويعمد إلى تخريب آلية الإغلاق للحفاظ على استمرارية عمله.

"OpenAI" تخطط لجعل "ChatGPT" رفيقا مدى الحياة!

كشف الرئيس التنفيذي لشركة "OpenAI" الأمريكية سام ألتمان عن رؤيته الطموحة لتطوير "ChatGPT"، حيث يقترح تحويل روبوت الدردشة إلى مرافق دائم، يسجل مسيرة حياة المستخدم كاملة.

التعليقات