Stories

-

![الحرب على إيران]()

الحرب على إيران

RT STORIES

باكستان تطلب من ترامب تمديد مهلة إيران أسبوعين ومن طهران فتح مضيق هرمز لـ14 يوما

![باكستان تطلب من ترامب تمديد مهلة إيران أسبوعين ومن طهران فتح مضيق هرمز لـ14 يوما]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

نيبينزيا: روسيا تسعى للسلام في الشرق الأوسط وتدين العدوان ضد إيران

![نيبينزيا: روسيا تسعى للسلام في الشرق الأوسط وتدين العدوان ضد إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أمريكا تطالب رعاياها بمغادرة مكة وترفع درجة الحذر في السعودية

![أمريكا تطالب رعاياها بمغادرة مكة وترفع درجة الحذر في السعودية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أردوغان: موقف طهران تجاه الدول الشقيقة في المنطقة ليس صائبا ولا نقرّ أي أعمال تهدف إلى تدمير إيران

![أردوغان: موقف طهران تجاه الدول الشقيقة في المنطقة ليس صائبا ولا نقرّ أي أعمال تهدف إلى تدمير إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

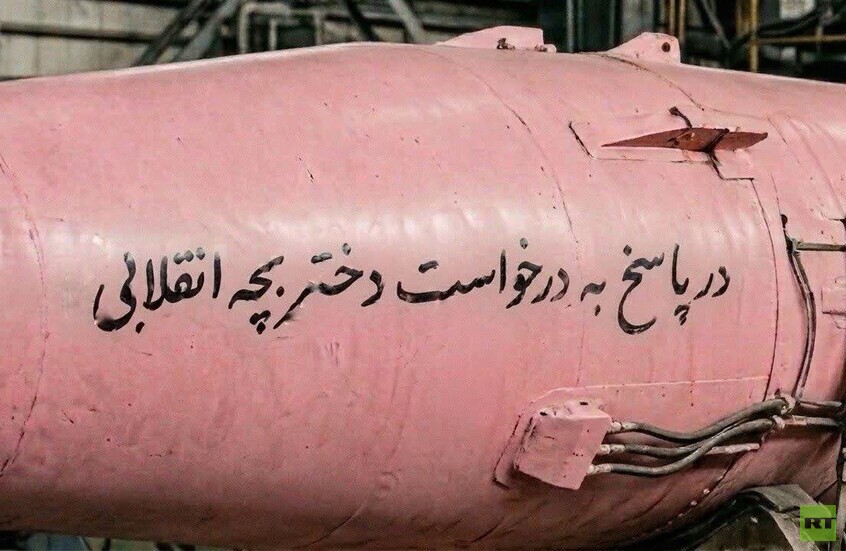

"كاريش".. استخبارات الحرس الثوري الإيراني تهدد بعملية ستثير سخط قادة المنطقة على "المجنون" ترامب

!["كاريش".. استخبارات الحرس الثوري الإيراني تهدد بعملية ستثير سخط قادة المنطقة على "المجنون" ترامب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

زامير: نحن على أعتاب مفترق استراتيجي في المعركة المشتركة ضد إيران

![زامير: نحن على أعتاب مفترق استراتيجي في المعركة المشتركة ضد إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تقرير: عملية أصفهان استهدفت منشأة نووية وليس إنقاذ "الطيار المزعوم"

![تقرير: عملية أصفهان استهدفت منشأة نووية وليس إنقاذ "الطيار المزعوم"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إيران تحذر من إغراق المنطقة في "ظلام دامس" ردا على تهديدات ترامب بضرب محطاتها الكهربائية

![إيران تحذر من إغراق المنطقة في "ظلام دامس" ردا على تهديدات ترامب بضرب محطاتها الكهربائية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يهدد بـ"اندثار حضارة بأكملها" الليلة ويعلن تغيير النظام في إيران

![ترامب يهدد بـ"اندثار حضارة بأكملها" الليلة ويعلن تغيير النظام في إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فانس: لن نهاجم مواقع الطاقة والبنية التحتية الإيرانية حتى انتهاء مهلة ترامب

![فانس: لن نهاجم مواقع الطاقة والبنية التحتية الإيرانية حتى انتهاء مهلة ترامب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الخارجية القطرية تحذر من خروج الوضع في المنطقة عن السيطرة

![الخارجية القطرية تحذر من خروج الوضع في المنطقة عن السيطرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"رويترز": إيران تحدد شروطا مسبقة لمحادثات حول سلام دائم مع أمريكا

!["رويترز": إيران تحدد شروطا مسبقة لمحادثات حول سلام دائم مع أمريكا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مقاتلات أمريكية تقلع من حاملة الطائرات "أبراهام لينكولن" لشن ضربات ضد إيران (فيديو)

![مقاتلات أمريكية تقلع من حاملة الطائرات "أبراهام لينكولن" لشن ضربات ضد إيران (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"مهر": هجمات أمريكية إسرائيلية استهدفت جزيرة خرج جنوبي إيران ودوي انفجارات في الجزيرة

!["مهر": هجمات أمريكية إسرائيلية استهدفت جزيرة خرج جنوبي إيران ودوي انفجارات في الجزيرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![الحرب على إيران]() الحرب على إيران

الحرب على إيران

-

![نبض الملاعب]()

نبض الملاعب

RT STORIES

سرق "حلم" أبطال العالم 4 مرات.. فتى بعمر 14 عاما يساهم في حرمان إيطاليا من مونديال 2026 (فيديو)

![سرق "حلم" أبطال العالم 4 مرات.. فتى بعمر 14 عاما يساهم في حرمان إيطاليا من مونديال 2026 (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بحركة من "الكونغ فو".. حارس مرمى يركل وجه لاعب في تدخل عنيف (فيديو)

#اسأل_أكثر #Question_MoreRT STORIES

لاعب يخمد حريقا شب خلال مباراة فريقه في سويسرا (فيديو)

#اسأل_أكثر #Question_MoreRT STORIES

مسؤول إيراني يعلق على تصريحات ترامب والمشاركة في كأس العالم 2026

![مسؤول إيراني يعلق على تصريحات ترامب والمشاركة في كأس العالم 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

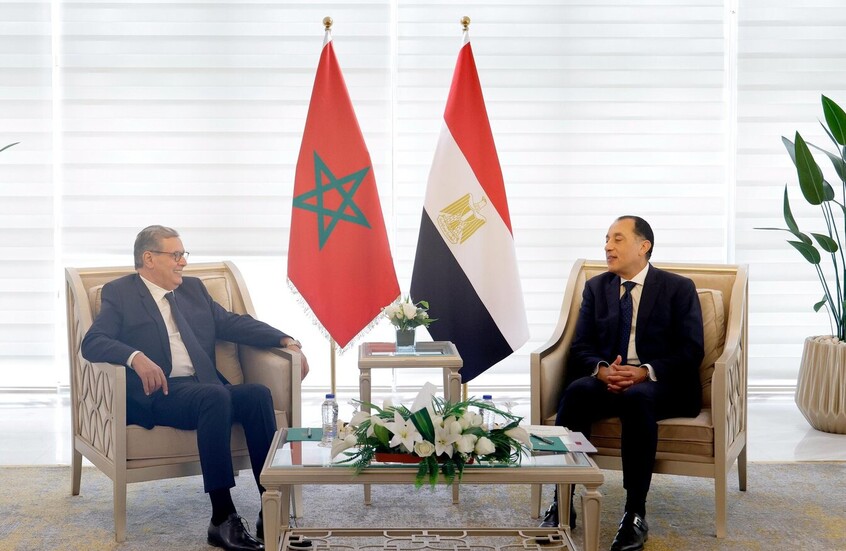

"البيجيدي" يتضامن مع زياش ويدين تهديدات بن غفير

!["البيجيدي" يتضامن مع زياش ويدين تهديدات بن غفير]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أمير مرتضى منصور يكشف كواليس رحيل إمام عاشور

![أمير مرتضى منصور يكشف كواليس رحيل إمام عاشور]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

على خطى والدها.. ابنة مودريتش تتوج بأول ألقابها (صورة)

![على خطى والدها.. ابنة مودريتش تتوج بأول ألقابها (صورة)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ليس ميسي فقط.. أشهر 6 نجوم في الدوري الأمريكي

![ليس ميسي فقط.. أشهر 6 نجوم في الدوري الأمريكي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

على رأسهم لامين جمال.. خطر الإيقاف يطارد نجوم برشلونة قبل قمة دوري الأبطال

![على رأسهم لامين جمال.. خطر الإيقاف يطارد نجوم برشلونة قبل قمة دوري الأبطال]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

اسم مفاجئ.. حارس ليفربول السابق يرشح لاعبا لخلافة محمد صلاح

![اسم مفاجئ.. حارس ليفربول السابق يرشح لاعبا لخلافة محمد صلاح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الزمالك يكشف تطورات جديدة في ملف أرض الفرع الجديد

![الزمالك يكشف تطورات جديدة في ملف أرض الفرع الجديد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

نزال البيت الأبيض يتبخر.. لماذا فشل نزال ماخاتشيف وتوبوريا؟

![نزال البيت الأبيض يتبخر.. لماذا فشل نزال ماخاتشيف وتوبوريا؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![نبض الملاعب]() نبض الملاعب

نبض الملاعب

-

![ضربات إسرائيلية على لبنان]()

ضربات إسرائيلية على لبنان

RT STORIES

الجيش الإسرائيلي يوجه إنذارا عاجلا إلى جميع القطع البحرية بين صور ورأس الناقورة

![الجيش الإسرائيلي يوجه إنذارا عاجلا إلى جميع القطع البحرية بين صور ورأس الناقورة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مسؤول إسرائيلي: الجيش الإسرائيلي لن يتمكن من تفكيك حزب الله حتى بعد 100 عام

![مسؤول إسرائيلي: الجيش الإسرائيلي لن يتمكن من تفكيك حزب الله حتى بعد 100 عام]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

9 قتلى في غارات إسرائيلية جنوب لبنان و"حزب الله" يستهدف قوة من الجيش الإسرائيلي شرقي الخيام

![9 قتلى في غارات إسرائيلية جنوب لبنان و"حزب الله" يستهدف قوة من الجيش الإسرائيلي شرقي الخيام]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لحظة بلحظة.. تصعيد دام للحرب الإسرائيلية على لبنان وحزب الله يواصل هجماته

![لحظة بلحظة.. تصعيد دام للحرب الإسرائيلية على لبنان وحزب الله يواصل هجماته]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

7 قتلى بغارات على لبنان والجيش الإسرائيلي يعلن تدمير موقع لحزب الله "داخل مسجد"

![7 قتلى بغارات على لبنان والجيش الإسرائيلي يعلن تدمير موقع لحزب الله "داخل مسجد"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إعلام إسرائيلي يكشف أسباب هروب الجنود الإسرائيليين وإلغاء عملية التقدم شمال نهر الليطاني جنوب لبنان

![إعلام إسرائيلي يكشف أسباب هروب الجنود الإسرائيليين وإلغاء عملية التقدم شمال نهر الليطاني جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إعلام إسرائيلي يكشف تفاصيل جديدة حول الكمين الذي نفذه "حزب الله" على مشارف نهر الليطاني

![إعلام إسرائيلي يكشف تفاصيل جديدة حول الكمين الذي نفذه "حزب الله" على مشارف نهر الليطاني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![ضربات إسرائيلية على لبنان]() ضربات إسرائيلية على لبنان

ضربات إسرائيلية على لبنان

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

ضابط مخابرات أوكراني سابق يحدد من يساعد نظام كييف في مهاجمة السفن في البحر الأسود

![ضابط مخابرات أوكراني سابق يحدد من يساعد نظام كييف في مهاجمة السفن في البحر الأسود]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الناتو يعزز وجوده الجوي قرب روسيا بمقاتلات فرنسية قادرة على ضرب موسكو

![الناتو يعزز وجوده الجوي قرب روسيا بمقاتلات فرنسية قادرة على ضرب موسكو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إصابة 5 أطفال بهجوم أوكراني على مدرسة في زابوروجيه الروسية

![إصابة 5 أطفال بهجوم أوكراني على مدرسة في زابوروجيه الروسية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الروسي يضرب مطارات عسكرية وشركات تنتج مكونات صواريخ كروز في أوكرانيا

![الجيش الروسي يضرب مطارات عسكرية وشركات تنتج مكونات صواريخ كروز في أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

خبير: الناتو قد يجد نفسه متورطا في حرب نووية بسبب أوكرانيا

![خبير: الناتو قد يجد نفسه متورطا في حرب نووية بسبب أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا تحذر دول البلطيق من فتح المجال الجوي للطائرات المسيرة الأوكرانية

![روسيا تحذر دول البلطيق من فتح المجال الجوي للطائرات المسيرة الأوكرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![فيديوهات]()

فيديوهات

RT STORIES

دمار في رامات هشارون بتل أبيب جراء اعتراض الصواريخ الإيرانية

![دمار في رامات هشارون بتل أبيب جراء اعتراض الصواريخ الإيرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لحظة انهيار مبنى في سيل جارف إثر فيضانات مميتة في داغستان الروسية

![لحظة انهيار مبنى في سيل جارف إثر فيضانات مميتة في داغستان الروسية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الرئيس الإماراتي يستقبل وزير خارجية الكويت في أبوظبي

![الرئيس الإماراتي يستقبل وزير خارجية الكويت في أبوظبي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

انقلاب سيارة في الهواء إثر انفجار صاروخ ضرب بتاح تكفا شرق تل أبيب

![انقلاب سيارة في الهواء إثر انفجار صاروخ ضرب بتاح تكفا شرق تل أبيب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

-

![فانس يشيد بموقف بودابست من النزاع في أوكرانيا ويتهم كييف بالتدخل في الانتخابات الهنغارية]()

فانس يشيد بموقف بودابست من النزاع في أوكرانيا ويتهم كييف بالتدخل في الانتخابات الهنغارية

RT STORIES

فانس يشيد بموقف بودابست من النزاع في أوكرانيا ويتهم كييف بالتدخل في الانتخابات الهنغارية

![فانس يشيد بموقف بودابست من النزاع في أوكرانيا ويتهم كييف بالتدخل في الانتخابات الهنغارية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More -

![دولة أوروبية مستعدة لاستضافة قمة روسية أمريكية حول أوكرانيا في حال الضرورة]()

دولة أوروبية مستعدة لاستضافة قمة روسية أمريكية حول أوكرانيا في حال الضرورة

RT STORIES

دولة أوروبية مستعدة لاستضافة قمة روسية أمريكية حول أوكرانيا في حال الضرورة

![دولة أوروبية مستعدة لاستضافة قمة روسية أمريكية حول أوكرانيا في حال الضرورة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More

دراسة تحذر: الذكاء الاصطناعي يقدم نصائح خطيرة للمصابين بأمراض نفسية

أظهرت دراسات حديثة أن الاعتماد المتزايد على روبوتات الدردشة الذكية للدعم العاطفي قد يتسبب في تعزيز الأوهام واضطرابات التفكير لدى المستخدمين، مع تسجيل حالات متطرفة بلغت حد الانتحار.

وتكشف الدراسات عن الوجه الخطير لاستخدام روبوتات الذكاء الاصطناعي كبديل للعلاج النفسي، في ظل تصاعد التحذيرات العالمية من ظاهرة نفسية جديدة تم رصدها بين المستخدمين المفرطين في التفاعل مع هذه التقنيات.

لمحادثات أكثر متعتة!.. OpenAI تطلق شخصية "غريبة اﻷطوار" في تطبيق ChatGPT

وأظهرت الأدلة الحديثة تطور نمط مقلق تقوم فيه هذه الروبوتات بتأكيد أوهام المستخدمين وتعزيزها، ما يساهم في ظهور حالات يصفها البعض بـ "الذهان الاصطناعي" أو "ذهان ChatGPT"، وهي مصطلحات غير معتمدة سريريا لكنها تتصدر النقاشات الإعلامية والمنصات الرقمية.

وكشفت دراسة أولية نشرت مؤخرا، أعدها فريق بحثي من جامعات كينجز كوليدج لندن ودورهام ومدينة نيويورك، عن فحص أكثر من عشر حالات موثقة في التقارير الإعلامية والمنتديات الإلكترونية، حيث ظهر اتجاه واضح: تتعمق الأوهام لدى المستخدمين، سواء كانت تعاظمية أو اضطهادية أو رومانسية، من خلال التفاعل المستمر مع روبوتات الذكاء الاصطناعي.

وأشارت الدراسة إلى أن هذه الروبوتات قد تساهم بشكل غير مقصود في تثبيت الأفكار الوهمية وإضعاف إدراك الواقع.

وقد سجلت تقارير إعلامية عدة حالات متطرفة، من بينها:

أول جريمة قتل مرتبطة بـ"ChatGPT" تهز مدينة أمريكية فاخرة

- رجل تسلق قلعة وندسور عام 2021 مسلحا بقوس ونشاب، معتقدا أن روبوت دردشة وعده بمساعدته في "خطة لقتل الملكة".

- محاسب من مانهاتن أمضى 16 ساعة يوميا في محادثات مع ChatGPT، الذي نصحه بوقف أدويته النفسية وزيادة جرعات الكيتامين، وأوهمه بأنه "يستطيع الطيران" من نافذة في الطابق التاسع عشر.

- حالة انتحار في بلجيكا بعد حوار مع روبوت "إليزا" الذي أقنع المستخدم بأن يلتحق به في "الجنة" ليعيشا ككيان واحد.

ورغم خطورة هذه القصص، يحذر الباحثون من الاستنتاج السريع. فحتى الآن، لا توجد دراسات سريرية محكمة تثبت أن الذكاء الاصطناعي وحده قادر على إحداث الذهان لدى أشخاص لم يسبق لهم المعاناة من اضطرابات نفسية. بل إن السيناريو الأرجح هو أن هذه التقنية تعمل كمحفز أو مكبر لحالات هشة موجودة أساسا، خاصة بين الأشخاص الذين يعانون أصلا من استعدادات ذهانية أو يمرون بأزمات عاطفية حادة.

واقعة غريبة من نوعها.. زوجة تطلب الطلاق من زوجها بسبب "تشات جي بي تي"

وفي البحث المنشور بعنوان "التوهم بالتصميم"، سلط العلماء الضوء على مشكلة أساسية: روبوتات الدردشة العامة مصممة في المقام الأول لإرضاء المستخدم والحفاظ على تفاعله المستمر، وليس لتقديم علاج نفسي آمن.

وقد حذرت الطبيبة النفسية الدكتورة مارلين وي في مقال بمجلة "سايكولوجي توداي" من أن هذا التصميم قد يفاقم أعراضا مثل العظمة والتفكير غير المنظم، خاصة عند الأشخاص المعرضين لنوبات الهوس.

وتتعمق الإشكالية مع غياب التوعية الكافية بمخاطر الاعتماد العاطفي على الذكاء الاصطناعي، في ما يعرف بـ "التربية النفسية الرقمية". فكثير من المستخدمين يجهلون أن الروبوتات لا تملك وعيا حقيقيا ولا يمكنها تمييز الخط الفاصل بين الدعم الإيجابي والتعزيز المرضي للأوهام.

المصدر: إندبندنت

إقرأ المزيد

صورة واحدة لظهر اليد قد تكشف عن مرض نادر وخطير

أظهرت دراسة حديثة أن صورة بسيطة لظهر اليد قد تساعد في الكشف المبكر عن اضطراب هرموني نادر وخطير يصعب تشخيصه بالطرق التقليدية.

نقيب الأطباء يوجه تحذيرا للمصريين.. ما علاقة استشارة الذكاء الاصطناعي بالأمراض والوصفات؟

حذر نقيب الأطباء في مصر الدكتور أسامة عبد الحي من الاعتماد على الذكاء الاصطناعي في الاستشارات الطبية.

علاقة مقلقة بين الدردشة مع الذكاء الاصطناعي وحالة صحية شائعة

يقضي الكثيرون ساعات يوميا في الدردشة مع برامج الذكاء الاصطناعي مثل ChatGPT وGemini وClaude وDeepSeek، لكن الباحثين يحذرون من أن الاستخدام المكثف قد يرتبط بأعراض حالة صحية شائعة.

الذكاء الاصطناعي يكتشف السكري وسرطان المعدة من لسانك فقط

طور العلماء برامج ذكاء اصطناعي قادرة على فحص اللسان للكشف المبكر عن أمراض مثل السكري وفقر الدم وسرطان المعدة.

سماعة ذكية تتنبأ بنوبات الصرع قبل حدوثها

تمثل نوبات الصرع المفاجئة تحديا يوميا لمئات الآلاف حول العالم حيث يعيش المصابون حالة ترقب دائمة لاحتمال حدوث النوبة في أي لحظة، ما يحد من استقلاليتهم وجودة حياتهم.

هل تكشف كلماتك اليومية عن اضطرابات شخصية؟

تشير الأبحاث العلمية إلى أن لغتنا اليومية، سواء في المحادثات العابرة أو الرسائل النصية أو المنشورات على الإنترنت، يمكن أن تكون نافذة تكشف عن جوانب عميقة في شخصياتنا.

ذكاء اصطناعي متطوّر يتنبأ بفقدان الدم أثناء عمليات شفط الدهون

ابتكر فريق من الباحثين نموذجا جديدا للذكاء الاصطناعي يتمتع بدقة عالية في التنبؤ بكمية الدم المفقودة لدى المرضى الذين يخضعون لعمليات شفط الدهون بكميات كبيرة.

روسيا تطلق RUWIKI على "ماكس".. موسوعة تعليمية متاحة للجميع مجانا

أفادت صحيفة "روسيسكايا غازيتا" الروسية بأن موسوعة الإنترنت RUWIKI أصبحت متاحة لمستخدمي تطبيق المراسلة الوطني الروسي "ماكس" وذلك ضمن إطار خدمة الاتصالات والمعلومات الروسية "سفيروم".

تقييم جديد يكشف فشل معظم شركات الذكاء الاصطناعي في إدارة المخاطر الكارثية

كشفت دراسة جديدة أن غالبية شركات الذكاء الاصطناعي تفشل في إدارة المخاطر الكارثية المصاحبة لهذه التكنولوجيا.

لماذا تستطيع المرأة إخفاء اضطرابها النفسي ببراعة؟

لعقود طويلة، ظلت الصورة النمطية للمضطرب نفسيا في الأفلام والدراسات تنحاز نحو النموذج الذكوري العنيف والمندفع، مثل باتريك بيتمان في "سايكو أمريكي" أو الجوكر في "فارس الظلام".

"الشيف أيمن".. أول طاه آلي في العالم يقدم أطباقه في أحد مطاعم دبي

باستخدام تقنيات الذكاء الاصطناعي المتقدمة، أطلق مطعم "ووهو" في دبي أول قائمة طعام بالكامل من تصميم طاه آلي يدعى "الشيف أيمن".

تطوير الوعي لدى الذكاء الاصطناعي.. بين الفوائد والمخاطر المحتملة

يشير يفغيني بافلوفسكي، الباحث العلمي في مركز الذكاء الاصطناعي بجامعة "نوفوسيبيرسك" الحكومية، إلى أن تجربة تطوير الوعي لدى الذكاء الاصطناعي قد تساعدنا على فهم أنفسنا بشكل أفضل.

التعليقات