Stories

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

أوربان يدعو الاتحاد الأوروبي لاستئناف واردات النفط والغاز من روسيا والإقرار بفشل سياسة عزل موسكو

![أوربان يدعو الاتحاد الأوروبي لاستئناف واردات النفط والغاز من روسيا والإقرار بفشل سياسة عزل موسكو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أوربان: أوكرانيا خسرت الصراع منذ زمن وطموحها للاندماج بالغرب عبر الناتو والاتحاد الأوروبي غير واقعي

![أوربان: أوكرانيا خسرت الصراع منذ زمن وطموحها للاندماج بالغرب عبر الناتو والاتحاد الأوروبي غير واقعي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لافروف يكشف مفتاح حل النزاع الأوكراني

![لافروف يكشف مفتاح حل النزاع الأوكراني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الكرملين: هدنة عيد الفصح التي أعلنها بوتين في أوكرانيا تحمل طابعا إنسانيا بحتا

![الكرملين: هدنة عيد الفصح التي أعلنها بوتين في أوكرانيا تحمل طابعا إنسانيا بحتا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

اعتقال عميل أوكراني في ماريوبول

![اعتقال عميل أوكراني في ماريوبول]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الكرملين: بوتين يعلن عن هدنة مؤقتة مع أوكرانيا بمناسبة عيد الفصح

![الكرملين: بوتين يعلن عن هدنة مؤقتة مع أوكرانيا بمناسبة عيد الفصح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

دميترييف في واشنطن لمناقشة اتفاق أوكرانيا والتعاون الاقتصادي مع إدارة ترامب

![دميترييف في واشنطن لمناقشة اتفاق أوكرانيا والتعاون الاقتصادي مع إدارة ترامب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

زيلينسكي يعلن استعداد أوكرانيا لخطواتِ مبادَلة بالمثل بعد إعلان الكرملين هدنة عيد الفصح

![زيلينسكي يعلن استعداد أوكرانيا لخطواتِ مبادَلة بالمثل بعد إعلان الكرملين هدنة عيد الفصح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية: استمرار تقدم قواتنا على كافة المحاور

![الدفاع الروسية: استمرار تقدم قواتنا على كافة المحاور]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![هدنة المضيق]()

هدنة المضيق

RT STORIES

قاليباف قبيل بدء مفاوضات إسلام آباد: لدينا حسن نية لكن لا نثق بالأمريكيين

![قاليباف قبيل بدء مفاوضات إسلام آباد: لدينا حسن نية لكن لا نثق بالأمريكيين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فانس في الواجهة.. طهران تفرض إيقاعها في مفاوضات إسلام أباد وتحصد ما تريد

![فانس في الواجهة.. طهران تفرض إيقاعها في مفاوضات إسلام أباد وتحصد ما تريد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إسرائيل تستعد لاحتمال انهيار التهدئة مع إيران وتفقد عنصرا هاما في المواجهة المقبلة

![إسرائيل تستعد لاحتمال انهيار التهدئة مع إيران وتفقد عنصرا هاما في المواجهة المقبلة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سي إن إن: مفاوضات واشنطن وطهران في إسلام آباد ستعقد بصيغتين "مباشرة" و "عبر وسطاء"

![سي إن إن: مفاوضات واشنطن وطهران في إسلام آباد ستعقد بصيغتين "مباشرة" و "عبر وسطاء"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

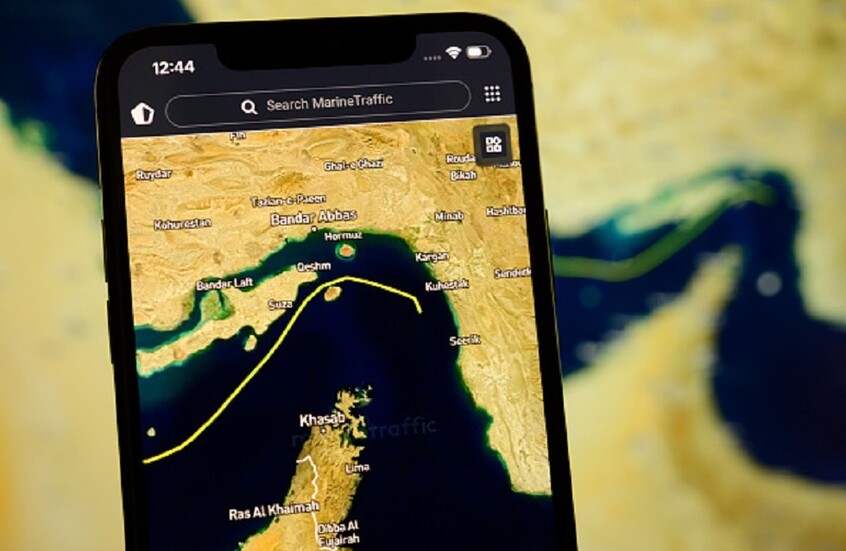

ترامب: لا أسلحة نووية شرط يمثل 99% من الاتفاق الجيد مع إيران وفتح مضيق هرمز أولوية

![ترامب: لا أسلحة نووية شرط يمثل 99% من الاتفاق الجيد مع إيران وفتح مضيق هرمز أولوية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

باكستان: نأمل في التوصل لوقف دائم لإطلاق النار بين الولايات المتحدة وإيران

![باكستان: نأمل في التوصل لوقف دائم لإطلاق النار بين الولايات المتحدة وإيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"رويترز": ستارمر وترامب يبحثان الخيارات العسكرية لتأمين مضيق هرمز

!["رويترز": ستارمر وترامب يبحثان الخيارات العسكرية لتأمين مضيق هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فانس: الولايات المتحدة مستعدة لمدّ يد العون لإيران

![فانس: الولايات المتحدة مستعدة لمدّ يد العون لإيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

طهران: خطتنا المقترحة هي أساس التفاوض مع الولايات المتحدة

![طهران: خطتنا المقترحة هي أساس التفاوض مع الولايات المتحدة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إسلام آباد تشدد الإجراءات الأمنية تمهيدا للمفاوضات الأمريكية الإيرانية

![إسلام آباد تشدد الإجراءات الأمنية تمهيدا للمفاوضات الأمريكية الإيرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سيئول تعين سفيرها السابق لدى الكويت مبعوثا خاصا إلى إيران

![سيئول تعين سفيرها السابق لدى الكويت مبعوثا خاصا إلى إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الحصيلة الكاملة للضربات الإسرائيلية على إيران

![الحصيلة الكاملة للضربات الإسرائيلية على إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![هدنة المضيق]() هدنة المضيق

هدنة المضيق

-

![لبنان تحت النيران الإسرائيلية]()

لبنان تحت النيران الإسرائيلية

RT STORIES

"حزب الله" ينفذ أكثر من 50 عملية ويستخدم صواريخ نوعية ضد إسرائيل "ردا على خرق اتفاق وقف النار"

!["حزب الله" ينفذ أكثر من 50 عملية ويستخدم صواريخ نوعية ضد إسرائيل "ردا على خرق اتفاق وقف النار"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تصعيد ليلي على الجبهة الشمالية.. عشرات الصواريخ والمسيرات من لبنان تستهدف الجليل

![تصعيد ليلي على الجبهة الشمالية.. عشرات الصواريخ والمسيرات من لبنان تستهدف الجليل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أكسيوس: واشنطن وبيروت تطلبان من إسرائيل تعليقا مؤقتا لهجماتها على حزب الله قبيل المفاوضات المرتقبة

![أكسيوس: واشنطن وبيروت تطلبان من إسرائيل تعليقا مؤقتا لهجماتها على حزب الله قبيل المفاوضات المرتقبة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الرئاسة اللبنانية: التوافق على عقد أول اجتماع رسمي لبناني إسرائيلي يوم الثلاثاء المقبل في واشنطن

![الرئاسة اللبنانية: التوافق على عقد أول اجتماع رسمي لبناني إسرائيلي يوم الثلاثاء المقبل في واشنطن]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

السفير الأمريكي لدى إسرائيل ينهي "6 أسابيع من التقشف" مع كلبين ويعود لمقره الرسمي

![السفير الأمريكي لدى إسرائيل ينهي "6 أسابيع من التقشف" مع كلبين ويعود لمقره الرسمي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لبنان: مقتل 24 شخصا بينهم 11 عنصرا من أمن الدولة في حصيلة محدثة للقصف الإسرائيلي (فيديو)

![لبنان: مقتل 24 شخصا بينهم 11 عنصرا من أمن الدولة في حصيلة محدثة للقصف الإسرائيلي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

قاسم: لن نقبل بالعودة إلى الوضع السابق ونحن معا كدولة وجيش وشعب ومقاومة نحمي بلدنا

![قاسم: لن نقبل بالعودة إلى الوضع السابق ونحن معا كدولة وجيش وشعب ومقاومة نحمي بلدنا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي: سنقصف المرافق الطبية وسيارات الإسعاف إذا استخدمها "حزب الله" (فيديو)

![الجيش الإسرائيلي: سنقصف المرافق الطبية وسيارات الإسعاف إذا استخدمها "حزب الله" (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس الأركان الإسرائيلي: ساحة القتال الرئيسية هي لبنان و"حزب الله" بات معزولا عن إيران

![رئيس الأركان الإسرائيلي: ساحة القتال الرئيسية هي لبنان و"حزب الله" بات معزولا عن إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

قاليباف يعيد نشر تأكيده حول ارتباط وقف إطلاق النار بلبنان.. ويحذر: "الوقت ينفد"

![قاليباف يعيد نشر تأكيده حول ارتباط وقف إطلاق النار بلبنان.. ويحذر: "الوقت ينفد"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وزراء إسرائيليون يدعون لهجمات كبيرة على لبنان: يجب تدمير بنيته التحتية وقطع الكهرباء عنه!

![وزراء إسرائيليون يدعون لهجمات كبيرة على لبنان: يجب تدمير بنيته التحتية وقطع الكهرباء عنه!]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![لبنان تحت النيران الإسرائيلية]() لبنان تحت النيران الإسرائيلية

لبنان تحت النيران الإسرائيلية

-

![نبض الملاعب]()

نبض الملاعب

RT STORIES

الزمالك يهزم شباب بلوزداد الجزائري بهدف برازيلي (فيديو)

![الزمالك يهزم شباب بلوزداد الجزائري بهدف برازيلي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فيديو مستفز للمغرب.. النصر يحتفل بعيد ميلاد ماني بكعكة "كأس إفريقيا" بحضور رونالدو وزملائه

![فيديو مستفز للمغرب.. النصر يحتفل بعيد ميلاد ماني بكعكة "كأس إفريقيا" بحضور رونالدو وزملائه]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رغم كل شيء.. صلاح يفوز بجائزة جديدة مع ليفربول (فيديو)

![رغم كل شيء.. صلاح يفوز بجائزة جديدة مع ليفربول (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رغم التهديد والوعيد.. لقطة طريفة بين "ملك الغجر" ومصارع "الدببة".. فيديو

![رغم التهديد والوعيد.. لقطة طريفة بين "ملك الغجر" ومصارع "الدببة".. فيديو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ميسي يبيع قطعة ثمينة "فريدة" من ممتلكاته في برشلونة

![ميسي يبيع قطعة ثمينة "فريدة" من ممتلكاته في برشلونة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رسميا.. تعيين مدرب جديد لمنتخب إيطاليا

![رسميا.. تعيين مدرب جديد لمنتخب إيطاليا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

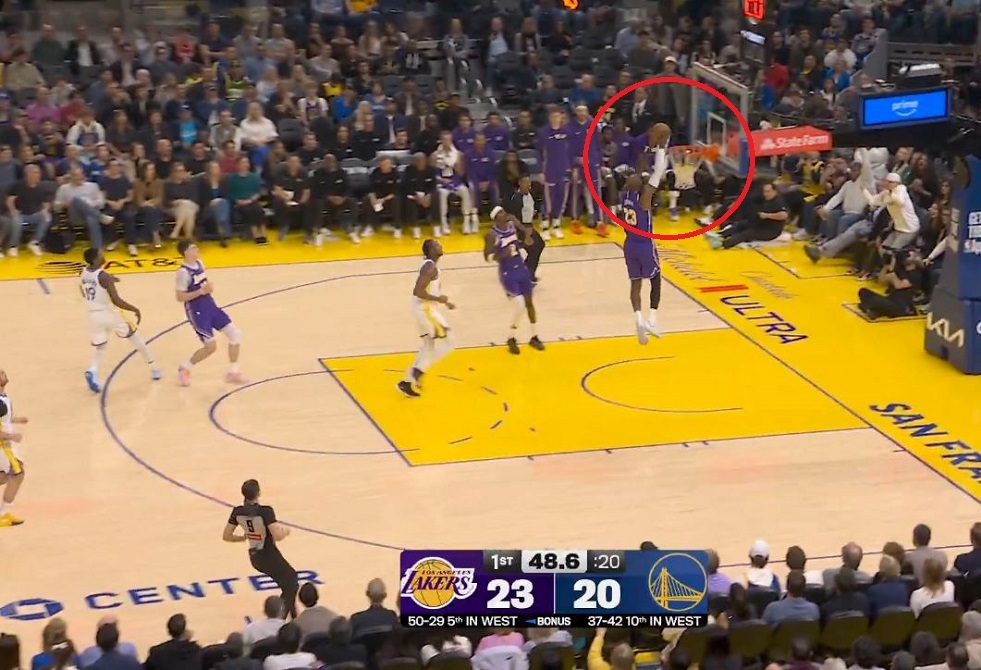

هذه المرة من "الابن للأب".. تاريخ جديد بين ليبرون جيمس ونجله (فيديو)

#اسأل_أكثر #Question_MoreRT STORIES

كم سعره؟.. إطلالة مميزة لكريستيانو رونالدو بطقم أحمر (صور)

![كم سعره؟.. إطلالة مميزة لكريستيانو رونالدو بطقم أحمر (صور)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"زيزو" يحسم موقفه من الرحيل عن الأهلي المصري بعد العرض الأمريكي (فيديو)

!["زيزو" يحسم موقفه من الرحيل عن الأهلي المصري بعد العرض الأمريكي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"بتعليق مفاجئ".. سلوت يرد على أنباء مغادرة ليفربول (فيديو)

!["بتعليق مفاجئ".. سلوت يرد على أنباء مغادرة ليفربول (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رسميا.. التلفزيون الجزائري يعلن بث مباراة شباب بلوزداد والزمالك

![رسميا.. التلفزيون الجزائري يعلن بث مباراة شباب بلوزداد والزمالك]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رد فعل الأهلي على عقوبات رابطة الأندية المصرية وإيقاف الشناوي (فيديو)

![رد فعل الأهلي على عقوبات رابطة الأندية المصرية وإيقاف الشناوي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"لم أقصد الإساءة إلى النساء".. انتقادات حادة تطارد نيمار بعد تصريحات جدلية

!["لم أقصد الإساءة إلى النساء".. انتقادات حادة تطارد نيمار بعد تصريحات جدلية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![نبض الملاعب]() نبض الملاعب

نبض الملاعب

-

![فيديوهات]()

فيديوهات

RT STORIES

لحظة وصول الوفد الإيراني إلى إسلام آباد

![لحظة وصول الوفد الإيراني إلى إسلام آباد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مشاهد لعمليات برية وغارات جوية نفذها الجيش الإسرائيلي ضد "حزب الله"

![مشاهد لعمليات برية وغارات جوية نفذها الجيش الإسرائيلي ضد "حزب الله"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صاروخ من "حزب الله" يستهدف موقف سيارات في صفد

![صاروخ من "حزب الله" يستهدف موقف سيارات في صفد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فيديو متداول لفتاة من بيروت يوثق فوضى وذعرا أثناء أعنف الغارات الإسرائيلية على لبنان

![فيديو متداول لفتاة من بيروت يوثق فوضى وذعرا أثناء أعنف الغارات الإسرائيلية على لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جدارية ضخمة على ساحل تل أبيب تنتقد نتنياهو وتصف الحرب على إيران بـ"فشل ذريع"

![جدارية ضخمة على ساحل تل أبيب تنتقد نتنياهو وتصف الحرب على إيران بـ"فشل ذريع"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تشييع جثمان رئيس المجلس الاستراتيجي للعلاقات الخارجية كمال خرازي

![تشييع جثمان رئيس المجلس الاستراتيجي للعلاقات الخارجية كمال خرازي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ولاية كنتاكي الأمريكية تستقبل جثمان جندية تحطمت طائرتها فوق العراق أثناء الحرب على إيران

![ولاية كنتاكي الأمريكية تستقبل جثمان جندية تحطمت طائرتها فوق العراق أثناء الحرب على إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مئات يتظاهرون في باريس ضد القانون الإسرائيلي لإعدام الأسرى الفلسطينيين

![مئات يتظاهرون في باريس ضد القانون الإسرائيلي لإعدام الأسرى الفلسطينيين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

عمالقة التكنولوجيا يطالبون بوقف تجارب الذكاء الاصطناعي خوفا من "مخاطر عميقة على المجتمع"

دعا الملياردير إيلون موسك ومجموعة من الخبراء يوم الأربعاء إلى التوقف عن تطوير أنظمة ذكاء اصطناعي قوية لإتاحة الوقت للتأكد من سلامتها.

وتمت المطالبة بخطاب مفتوح، وقع عليه أكثر من 1000 شخص حتى الآن، بما في ذلك موسك والمؤسس المشارك لشركة آبل، ستيف وزنياك، من خلال إصدار GPT-4 من شركة OpenAI المدعومة من مايكروسوفت.

وتقول الشركة إن أحدث طراز لها أقوى بكثير من الإصدار السابق، والذي تم استخدامه لتشغيل ChatGPT، وهو روبوت قادر على توليد أجزاء من النص من أقصر المطالبات.

وجاء في الرسالة المفتوحة بعنوان "إيقاف تجارب الذكاء الاصطناعي العملاقة مؤقتا": "يمكن لأنظمة الذكاء الاصطناعي ذات الذكاء التنافسي البشري أن تشكل مخاطر عميقة على المجتمع والإنسانية".

وقالت: "يجب تطوير أنظمة ذكاء اصطناعي قوية فقط بمجرد أن نكون واثقين من أن آثارها ستكون إيجابية وأن مخاطرها ستكون تحت السيطرة".

وكان موسك مستثمرا أوليا في OpenAI، وقضى سنوات في مجلس إدارتها، وتقوم شركته "تسلا" بتطوير أنظمة الذكاء الاصطناعي للمساعدة في تشغيل تكنولوجيا القيادة الذاتية، من بين تطبيقات أخرى.

وتم التوقيع على الرسالة، التي استضافها معهد Future of Life الممول من موسك، من قبل نقاد بارزين بالإضافة إلى منافسي OpenAI مثل رئيس Stability AI عماد موستيك.

مهندس سابق في غوغل تنبأ بالمستقبل بدقة 86%: سيحقق البشر الخلود في ثماني سنوات!

وحذر رائد الذكاء الاصطناعي الكندي يوشوا بنجيو، وهو أحد الموقعين أيضا، في مؤتمر صحفي افتراضي في مونتريال من "أن المجتمع ليس مستعدا" لهذه الأداة القوية وإساءة استخدامها المحتملة.

وقال: "دعونا نبطئ. دعونا نتأكد من أننا نطور حواجز حماية أفضل"، داعيا إلى مناقشة دولية شاملة حول الذكاء الاصطناعي وآثاره، "كما فعلنا مع الطاقة النووية والأسلحة النووية".

واقتبس الخطاب من مدونة كتبها مؤسس OpenAI سام ألتمان، الذي اقترح أنه "في مرحلة ما، قد يكون من المهم الحصول على مراجعة مستقلة قبل البدء في تدريب الأنظمة المستقبلية".

وكتب معدو الرسالة المفتوحة: "نحن متفقون. هذه النقطة هي الآن. لذلك، ندعو جميع مختبرات الذكاء الاصطناعي إلى التوقف فورا لمدة 6 أشهر على الأقل عن تدريب أنظمة الذكاء الاصطناعي الأكثر قوة من GPT-4".

ودعوا الحكومات إلى التدخل وفرض تجميد إذا فشلت الشركات في الاتفاق.

ويجب استخدام الأشهر الستة لتطوير بروتوكولات السلامة وأنظمة حوكمة الذكاء الاصطناعي وإعادة تركيز البحث على ضمان أن تكون أنظمة الذكاء الاصطناعي أكثر دقة وأمانا و"جديرة بالثقة والولاء".

ولم تُفصّل الرسالة الأخطار التي كشفت عنها GPT-4.

لكن الباحثين، بمن فيهم غاري ماركوس من جامعة نيويورك، الذي وقع الرسالة، جادلوا منذ فترة طويلة بأن روبوتات الدردشة كاذبة كبيرة ولديها القدرة على أن تكون وسيلة منتشرة على نطاق واسع لبث المعلومات المضللة.

المصدر: ساينس ألرت

التعليقات